エッジ生成AIの基礎

*このブログはSeeed社の許可を得て、スイッチサイエンスが翻訳しています。翻訳ページの無断転載および商用利用でのリンクはお控えください(ご利用の場合には当社宛にご連絡ください)。

元記事:Generative AI at the Edge Fundamentals: What is it and how it works?、By Jennie Wang

現代の生成AIトレンドにおける大きな突破口は、GPT(Generative Pre-trained Transformer)の登場でした。GPTのコア技術は、インターネットから膨大なデータを活用し、AIモデルの汎用化を可能にしました。従来のAIの手法は、あらかじめ定められたルールやパターンに大きく依存し、データとラベルの関係を学習して予測を行うことに限られていたのに対して、GPTはこのような制約を解決しています。

生成AIの流行によって、キーボードや口頭で機械にプロンプトを入力するだけで、柔軟かつ無制限に出力が可能になり、生活がより便利かつスマートになります。生成AIの原理とその可能性を詳しく見ていきましょう。

生成AIとは

生成AIは、ディープニューラルネットワークに基づいて、非構造化データのパターンから学習するように設計されています。初期のトレーニングでは教師なし学習と半教師あり学習を組み合わせて学習し、微調整フェーズで教師あり学習をシームレスに統合します。これにより、テキスト、画像、音声、合成データなど、さまざまな領域で効率と精度が向上した新しいオリジナル コンテンツをモデルが自律的に作成できるようになります。詳細については、Generative AI Web サイトをご覧ください。

基礎となる生成AIアーキテクチャ

基礎モデルの枠組みを理解することは、事前に学習されたモデルとして、さまざまな下流タスクの出発点となる役割を認識することが含まれます。

基礎となるアーキテクチャとしてTransformerを活用し、基礎モデルを構築して膨大な量のデータで事前トレーニングします。事前トレーニングが完了すると、モデルは特定のタスクに合わせて微調整したり、言語生成、テキスト補完、画像合成など、様々なクリエイティブアプリケーションにそのまま使用出来ます。

Transformer

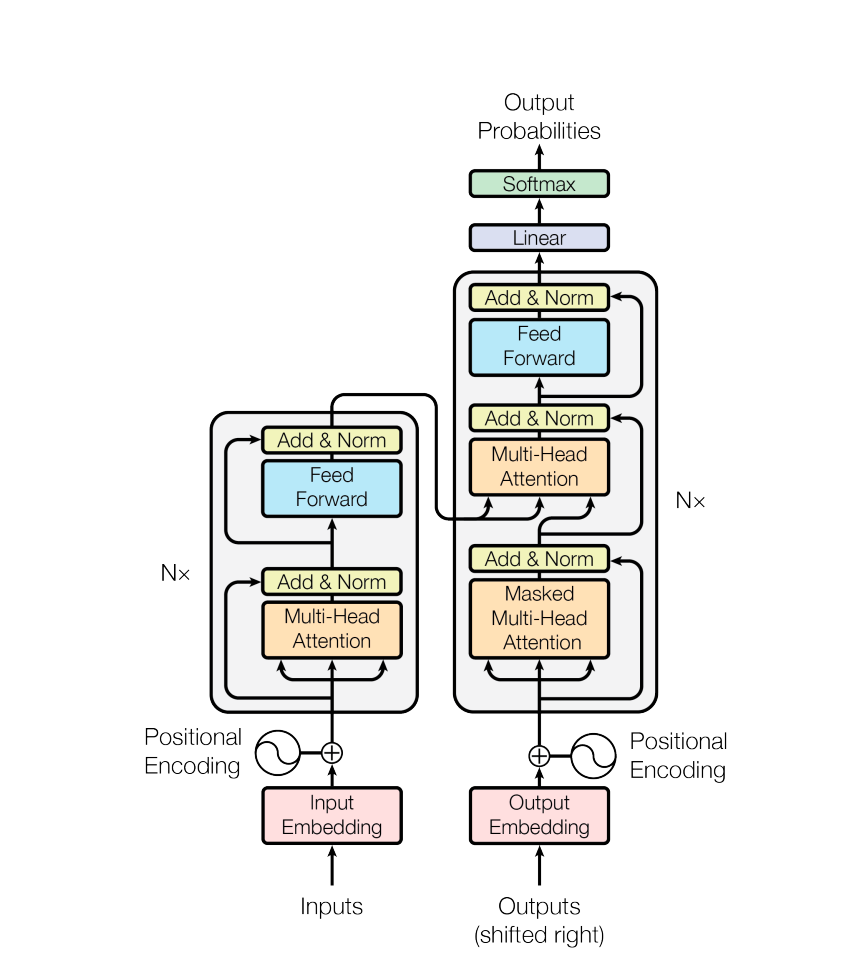

Transformerフレームワークは、自然言語処理における革新的なアーキテクチャで、エンコーダ・デコーダ構造と自己注意機構によって特徴付けられます。入力全体を順番に処理するのではなく、全体に注意を払います。

The transformer model architecture. Image from paper “Attention Is All You Need”

エンコーダでは、入力シーケンスが多頭自己注意を受け、モデルはシーケンス内の異なる部分に同時に焦点を当てることができます。デコーダは出力シーケンスの生成を担当し、位置エンコーディングなどの追加要素を組み込むことで単語の順序を保持します。

各レイヤー内のフィードフォワード型のニューラルネットワークは、注意機構から得た情報を処理し、データ内の複雑な関係を捉えることを可能にします。さらに、レイヤー正規化と残差接続により、モデルの安定的で効率的なトレーニングが実現し、時系列データの複雑なパターンを効果的に学習できます。

基盤モデル

基盤モデルのフレームワークを理解するには、それがさまざまな下流タスクの出発点としての役割を果たしていることを認識する必要があります。

GPTのような言語モデルを例に取ると、基盤モデルは多様で膨大なデータセットを用いて、教師なし学習を通じてトレーニングされます。この事前学習のフェーズで、モデルは言語の微妙な関係性やパターンを学習します。結果として得られた基盤モデルは、特定のタスクやアプリケーション向けに微調整され、学習した知識を活用してより専門的な課題に対応します。

このような事前学習と微調整のアプローチにより、基盤モデルは、テキスト補完から感情分析まで、幅広い言語関連のタスクで優れた性能を発揮します。エッジで展開可能な典型的な基盤モデルの例をいくつか見てみましょう。

LLM

LLM(Large Language Modelー大規模言語モデル)は、自然言語処理と機械学習の領域で非常に強力なAIモデルです。多様なテキストデータで広範にトレーニングされており、人間のような言語を理解し生成する能力に優れています。この多用途のモデルは、特定の言語タスクやドメインに合わせて微調整することができます。

LLMの重要な応用例として、NVIDIA Riva ASR/TTS 技術を利用した革新的な対話型チャットアプリケーションである Llamaspeak が挙げられます。これは、ユーザーがローカルで実行されるLLMと音声で対話し、コミュニケーションのインタラクティブかつダイナミックな性質を強めます。

reComputerにRivaとLlama2をデプロイしてローカル チャットボットを構築する方法については、Wikiを参照してください

CLIP

CLIP(Contrastive Language-Image Pretraining)は、OpenAIが開発したコンピュータビジョンモデルです。ゼロショット転送、自然言語による教師あり学習、マルチモーダル学習に基づいた大規模な研究を活用し、画像とその対応するテキストの説明の関係を理解することに優れています。

CLIPを使用すれば、シーン内のオブジェクトが属する可能性のあるプロンプトや説明を定義するだけで、事前学習を活かしてその画像やビデオに対して最も適切なクラスを予測します。

CLIPの具体的な応用例として、Vision Transformers(OWL-ViT)と組み合わせた例が挙げられます。この組み合わせによって、ゼロショットでの物体検出と分類を可能にし、データのラベリング工程を効率化するだけでなく、モデルがこれまで遭遇したことのないオブジェクトをも分類できるようにします。

生成型AIモデルの種類

Text-to-Text

Text-to-Textモデルは、自然言語の入力を、それに対応するテキスト出力にシームレスに変換します。テキストペア間のマッピングを理解し生成するように特別に訓練されており、多言語翻訳、文書要約、情報抽出、検索、コンテンツクラスタリング、コンテンツ編集・リライトなど、幅広いタスクに適用可能です。

Text-to-Image

テキストから画像を生成するモデルは、AIの新たなフロンティアを代表するものであり、画像とそれに対応する簡潔なテキスト説明が対になった大規模なデータセットで訓練されています。

このようなモデルは、拡散のような手法を活用し、テキストの指示とそれに対応する視覚的特徴との複雑な関係を徐々に洗練して理解することで、テキストの指示を鮮やかなビジュアル出力に変換する能力に優れています。主な応用の一つとして、画像生成や編集の分野があり、テキストから視覚的な概念を理解して表現するモデルの能力が、創造性や効率を向上させています。

Text-to-Task

Text-to-Taskモデルは、テキスト入力に基づいて特定のアクションやタスクを実行するように訓練されています。これには、質問への回答、検索の実行、予測の作成などが含まれます。バーチャルアシスタントや自動化分野でその応用が進んでおり、操作の効率を高めています。

生成AIの構築と応用

SeeedのreServerエッジデバイスで生成型AIアプリケーションを構築する話をしてみましょう。reServerがチャットボット、ビジョントランスフォーマー、AI NAS、およびスマート検索エンジンとして活用できるようになります。

これらの生成型AIタスクをエッジでスムーズに実行するために、NVIDIA Jetsonは大規模言語モデル(LLM)、ビジョントランスフォーマー、Stable Diffusionを効率的かつ安定してローカルで実行することができます。これには、Jetson AGX Orin上で最大のLlama-2-70Bモデル、およびインタラクティブな速度で動作するLlama-2-13Bも含まれます。

Jetson Orin NXは100 TOPSのAI性能を誇り、私たちのreServer Industrial J4012エッジデバイスと組み合わせることで、現場でのビデオ解析タスクをシームレスに実行できます。2つの2.5インチSATA HDD/SSD用ドライブベイを備え、5つのGbE RJ45ポートのうち4つが802.3af PSE対応となっており、リアルタイム処理を伴う複数ストリームでローカル大規模言語モデルを展開するのに理想的です。

miniGPT-4を使って文章を作成したり、画像の説明を生成したり、バーチャルな対話エージェントを展開したり、手書きの原稿からウェブサイトを作成することが簡単にできます。

環境認識に取り組む際には、LLaVAモデルに基づいたVision2Audioが視覚と音のギャップを埋め、視覚障害者が周囲の環境を音声指示で認識できるようにします。

マルチモーダル入力を理解するために、CLIPを使用したゼロショット学習を通じて多様なクラスを一般化することができます。CLIPは、テキストの説明に基づいた画像の分類から、特定のテキストクエリに対応する画像の検索まで、さまざまなタスクで優れた性能を発揮します。また、物体検出、テキストベースの画像生成、感情分析、視覚的質問応答などの自然言語処理にも活用でき、画像とテキストデータの微妙な理解が求められるAIアプリケーションにとって強力なツールとなっています。reComputer Jetson Orin NX上でのCLIPのデモ展開方法をぜひご覧ください。

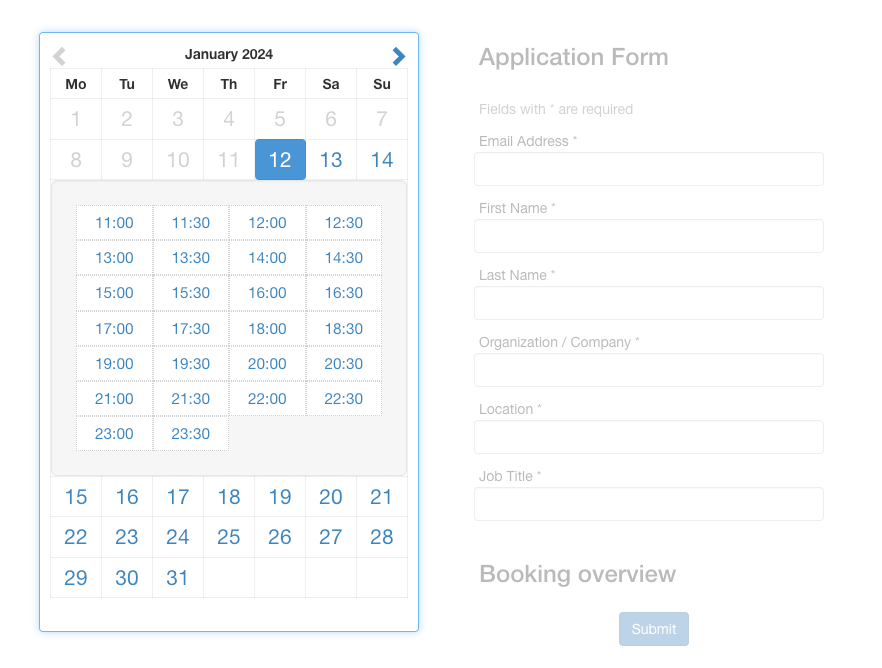

NVIDIA Jetson AGX Orin Developer Kitの無料バーチャルトライアル!

(このバーチャルトライアルについて、現時点では提供されていないようで確認中です。)

初めての生成型AIアプリケーションに取り組む準備はできていますか?NVIDIA Jetson AGX Orin Developer Kitの無料バーチャル試用版をスケジュール(※Seeed社のコンテンツにリンクします)してみましょう。最先端の生成型AI技術で、あなたの創造的なアイデアを現実の世界に解き放ちましょう!